Seite

43

Computersimulation

Beispiel: Eine Computersimulation zur kognitiven Repräsentation von Zahlen II

Netzaufbau

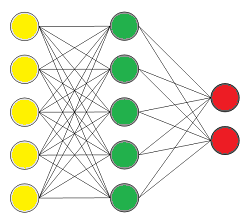

Das von Verguts, Fias und Stevens (2005) verwendete neuronale Netz stellte ein Feedforward-Netz mit einer Input-, einer Hidden- und einer Output-Schicht dar (Abb. 8):

- Input-Schicht: Die Input-Schicht bestand aus 15 Units, wobei jede Einheit eine arabische Zahl repräsentierte. Die erste Unit bildete die Zahl 1 ab, die zweite Einheit die 2 usw. bis zur Zahl 15. Dass genau 15 Zahlen durch das Netz abgebildet werden sollten, wurde durch die Autoren vorab willkürlich festgelegt, wobei verschiedene empirische Studien (unter anderem Butterworth, Zorzi, Girelli, & Jonckheere, 2001) dafür sprachen, zwischen 10 und 20 Zahlen einzusetzen. Zur Präsentation einer bestimmten Zahl wurde die entsprechende Unit auf den Wert Eins gesetzt, während allen anderen Einheiten der Wert Null zugewiesen wurde. Sofern in einer Simulation zwei Zahlen hinsichtlich ihrer Größe miteinander verglichen werden sollten, wurde die doppelte Anzahl an Input-Units eingesetzt. Die ersten 15 Neuronen wurden für die erste Zahl, die zweiten 15 Einheiten für die zweite Zahl reserviert.

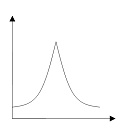

- Hidden-Schicht: Die Hidden-Schicht umfasste wie die Input- Schicht 15 Neuronen, bei der jede Unit ebenfalls eine einzelne Zahl repräsentiert. Die Einheiten sind mit der vorangegangenen Schicht fest verknüpft, so dass jedes Input-Neuron die korrespondierende Hidden-Unit mit maximaler Stärke aktiviert (z.B. die Input-Unit "13" die Hidden-Unit "13"). Die umgebenden Einheiten werden in geringerer Stärke aktiviert und zwar umso schwächer, je weiter sie von der Einheit entfernt sind. Die hierbei verwendete Formel beschreibt einen exponentiellen Verlauf und zwar in beide "Richtungen" (größere und kleinere Zahlen) der jeweils ausgewählten Zahl (z.B. 13). Abb. 9 veranschaulicht den Sachverhalt graphisch, wobei sich auf der x-Achse die in eine Rangreihe gebrachten Zahlen befinden, während die y-Achse die Stärke der Aktivierung abbildet. Die "Nachbarschaftsfunktionen" der einzelnen Units der Hidden-Schicht besaßen jeweils den gleichen Kurvenverlauf mit der gleichen "Breite". Die verwendete Aktivitätsfunktion der Hidden-Units beinhaltete eine fixierte Schwelle. Wie in der Input-Schicht kam auch in der Hidden-Schicht bei einem Vergleich zweier Zahlen hinsichtlich ihrer Größe die doppelte Anzahl an Hidden-Units, d.h. 30 Einheiten, zum Einsatz.

- Output-Schicht: Im Gegensatz zur Input- und Hidden-Schicht hing die verwendete Output-Schicht von der Art der Aufgabenstellung ab. Während zur Benennung von Zahlen 15 Output-Einheiten Verwendung fanden, wurden zur Beurteilung, ob es sich um eine gerade oder ungerade Zahl handelte sowie zum Vergleich zweier Zahlen hinsichtlich ihrer Größe, jeweils zwei Output-Units eingesetzt.

Trainingsphase

In der Trainingsphase wurden die korrekten Output-Werte auf Basis der Beobachtungen von Dehaene und Mehler (1992) zur Wahrscheinlichkeit des Auftretens von Zahlen vorgegeben (supervised learning). Folglich wurden dem Netz kleine Zahlen häufiger dargeboten als große Zahlen.

Bsp. I

Bsp. I